探秘 Pytorch 图神经网络参数初始化的奥秘

Pytorch 图神经网络的参数初始化是一个至关重要的环节,它直接影响着模型的性能和训练效果,在深度学习领域,图神经网络作为一种强大的工具,正被广泛应用于各种复杂的任务中,而正确地初始化参数,对于图神经网络的成功应用起着关键作用。

图神经网络的参数初始化并非简单的随机赋值,它需要考虑诸多因素,如网络结构、数据特点以及任务需求等,合理的参数初始化能够加速模型的收敛,提高模型的泛化能力,避免陷入局部最优解。

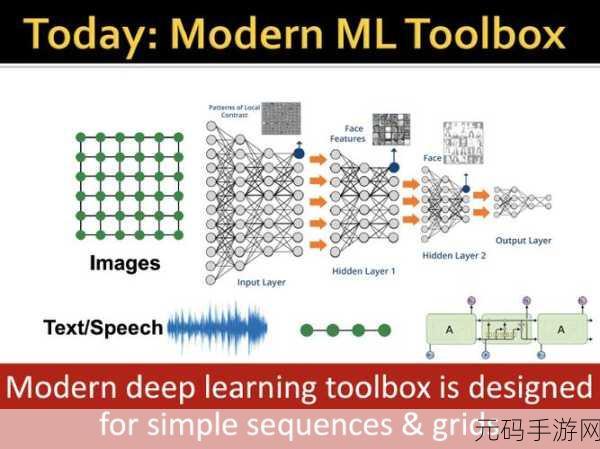

不同的初始化方法会带来不同的效果,常见的初始化方法包括随机初始化、正态分布初始化、均匀分布初始化等,每种方法都有其特点和适用场景,随机初始化可以为模型提供多样性,但可能导致训练初期的不稳定;正态分布初始化则在某些情况下能够使模型更快地收敛。

在实际应用中,选择合适的参数初始化方法需要结合具体问题进行分析,对于大规模的图神经网络,初始化参数时还需要考虑计算效率和内存占用等问题。

一些先进的初始化技术,如基于数据自适应的初始化方法,正逐渐受到关注,这些方法能够根据输入数据的特征自动调整参数的初始化值,从而更好地适应特定的任务和数据集。

深入理解和掌握 Pytorch 图神经网络的参数初始化技术,对于开发高效、准确的图神经网络模型具有重要意义,通过不断探索和创新,我们能够在这个充满挑战和机遇的领域取得更加出色的成果。

参考来源:相关深度学习研究文献及技术博客。